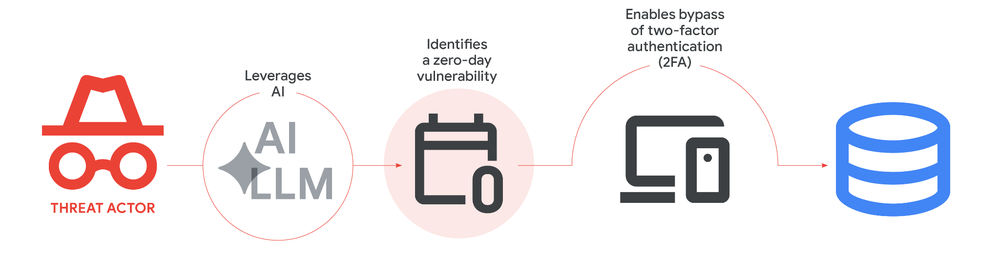

Google Threat Intelligence Group mengungkap apa yang mereka nilai sebagai kasus pertama di mana peretas memakai AI untuk menemukan celah software yang sebelumnya belum diketahui publik, lalu menyusun exploit untuk memakainya dalam serangan skala besar.

Perkembangan ini penting karena menggeser AI dari sekadar alat bantu produktivitas bagi pelaku siber menjadi bagian langsung dari rantai serangan. Batas yang sebelumnya banyak dibahas sebagai risiko teoretis kini mulai berubah menjadi insiden nyata yang berhasil diamati di lapangan.

Celahnya bukan bug biasa, tetapi logika yang salah

Serangan itu tidak bertumpu pada memory corruption atau kesalahan implementasi yang umum. Google menilai celahnya berupa semantic logic flaw, yakni asumsi kepercayaan yang ditanam pengembang ke dalam sistem, sehingga lapisan autentikasi kedua bisa dilewati setelah pelaku lebih dulu memiliki kredensial user yang valid.

Petunjuk keterlibatan AI muncul dari script exploit yang ditemukan. Google melihat adanya hallucinaton berupa skor CVSS yang tidak akurat, ditambah format penulisan yang dianggap sangat khas keluaran model bahasa besar yang dilatih pada data teknis. Jejak seperti ini membuat GTIG mengatakan mereka punya tingkat keyakinan tinggi bahwa AI dipakai untuk membantu discovery sekaligus weaponization celah tersebut.

Implikasinya cukup besar karena 2FA selama ini diperlakukan sebagai lapisan pertahanan penting untuk akun administrasi, layanan finansial digital, dan akses bernilai tinggi lain. Kalau model frontier mulai mampu menemukan flaw logika seperti ini, titik rawan ke depan tidak lagi hanya ada pada bug rendah level, tetapi juga pada desain kepercayaan yang terlihat wajar bagi developer manusia.

AI kini mulai dipakai di lebih banyak tahap serangan

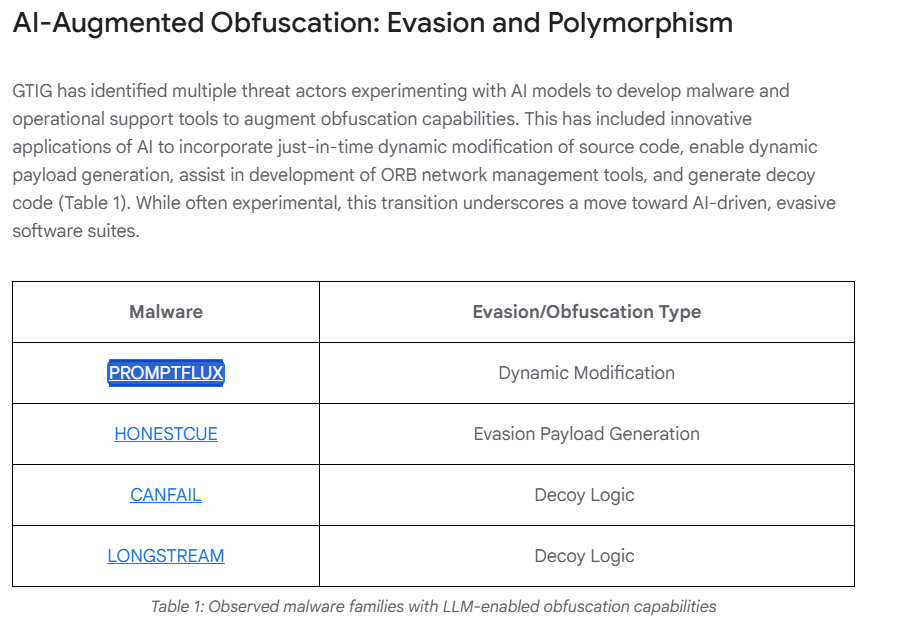

Kasus ini tidak berdiri sendiri. Google sebelumnya sudah mendokumentasikan pergeseran yang lebih luas, yakni pelaku ancaman tidak lagi memakai AI hanya untuk riset ringan atau drafting phishing, tetapi mulai menggunakannya untuk obfuscation dinamis, pengembangan malware, dan vulnerability research.

Salah satu contoh yang pernah diangkat adalah PROMPTFLUX, malware eksperimental yang memakai model AI untuk membantu menyamarkan dirinya secara just-in-time agar lebih sulit dideteksi.

Pasar gelap untuk tooling AI ilegal juga disebut semakin matang sepanjang 2025. Google menggambarkan adanya penawaran multifungsi yang mendukung phishing, malware development, dan vulnerability research, sehingga hambatan masuk untuk pelaku yang kurang canggih ikut turun. Artinya, ancaman AI-driven attack tidak harus menunggu aktor negara; kriminal biasa pun mulai punya akses ke alat yang lebih kuat.

Ini bukan ledakan penuh, tapi sinyalnya sudah sangat jelas

Google menilai kasus ini kemungkinan baru puncak kecil dari perubahan yang lebih besar. Serangan yang berhasil dihentikan ini menunjukkan bahwa frontier model kini mulai cukup berguna untuk membantu menemukan flaw tingkat tinggi, bukan hanya menghasilkan kode kasar atau konten tipuan. Itu membuat organisasi tidak lagi cukup hanya memikirkan patching cepat, tetapi juga harus meninjau ulang asumsi trust, alur autentikasi, dan dependency open-source yang mereka pakai.

Bagi industri kripto dan layanan digital yang bertumpu pada MFA, pelajarannya cukup tegas: lapisan keamanan tambahan tetap penting, tetapi tidak boleh diperlakukan sebagai garis pertahanan yang berdiri sendiri.

Saat AI mulai membantu pelaku menemukan cara mem-bypass logika sistem, pertahanan ke depan akan lebih bergantung pada kombinasi desain aplikasi yang ketat, monitoring perilaku, segmentasi akses, dan respons cepat saat anomali muncul.

Disclaimer: Artikel ini disusun untuk tujuan informasi dan edukasi. Isi artikel bukan merupakan nasihat keuangan, investasi, hukum, atau rekomendasi transaksi. Selalu lakukan riset mandiri dan pahami risiko sebelum mengambil keputusan.